Martin Hilbert: "La verdadera fuente de poder de las redes ha sido

llevarnos a nuestro narcisismo, enojo, ansiedad, envidia, credulidad y,

por cierto, a nuestra lujuria".

Por Daniel Hopenhayn. Especial para

BBC Mundo.

"El crecimiento de la digitalización siempre fue exponencial, pero la

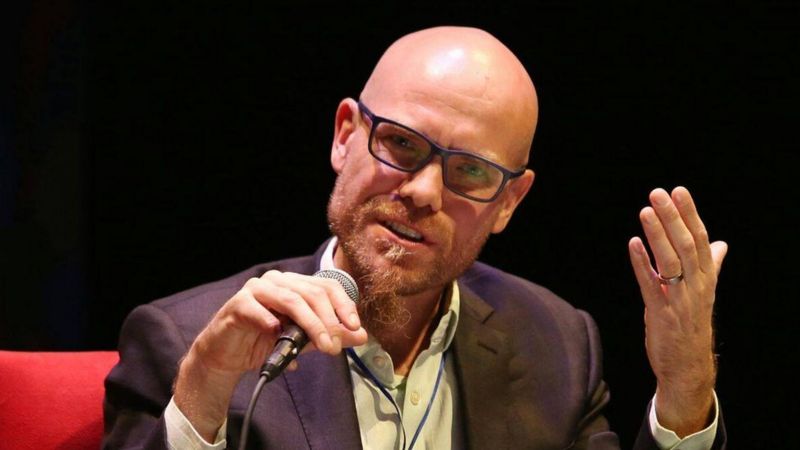

pandemia lo aceleró con esteroides", asegura Martin Hilbert, investigador

alemán de la Universidad de California-Davis y autor del primer estudio

que calculó cuánta información hay en el mundo.

|

| Martin Hilbert, imagen vista en BBC |

Esto debiera preocupar especialmente a América Latina, "porque son líderes

mundiales en el uso de redes sociales", advierte Hilbert, que vivió una

década en Chile como funcionario de la ONU y hoy vive a 40 minutos de

Silicon Valley.

En conversación con BBC Mundo compartió su opinión de que las nuevas

tecnologías plantean desafíos de alcances tales que podrían exigir una

evolución de la conciencia humana.

¿Qué novedades trajo la pandemia a nuestra relación con las redes

digitales?

Tuvo dos efectos simultáneos: nos hizo más sensibles a las secuelas

tóxicas de la digitalización, pero aceleró nuestra dependencia de ella.

Y también confirmó que el segundo efecto es más poderoso que el primero:

ser conscientes de que esta adicción nos hace mal no produce ningún

cambio en nuestras conductas.

"Las llamadas tecnologías persuasivas cumplen su misión cuando eres adicto y no puedes desviar tu atención de ellas"

¿Por qué crees que ocurre eso?

Hay que entender cómo funciona esta economía digital, donde el recurso

escaso a explotar es la atención humana.

El negocio de los gigantes tecnológicos −Google, Apple, Facebook,

Amazon− no es ofrecerte avisos comerciales: es modificar tus

comportamientos para optimizar el rendimiento de esos avisos.

Y pueden hacerlo porque los algoritmos, al procesar millones de datos

sobre tu comportamiento, aprenden a predecirlo, mucho mejor que tú

mismo.

Pero para conocerte e influir sobre ti necesitan mantenerte conectado.

Por lo tanto, las llamadas tecnologías persuasivas cumplen su misión

cuando eres adicto y no puedes desviar tu atención de ellas.

Por lo que muestra el documental El dilema de las redes sociales,

muchos en Silicon Valley se arrepienten de haber creado esas

tecnologías.

Aquí en Silicon Valley el término de moda es human downgrading

[degradación humana], que resume la siguiente idea: de tanto discutir

cuándo la tecnología iba a sobrepasar nuestras capacidades, perdimos de

vista que las máquinas se estaban enfocando en conocer nuestras

debilidades.

Ganarle una partida al campeón de ajedrez era lo de menos. Su verdadera

fuente de poder ha sido llevarnos a nuestro narcisismo, a nuestro enojo,

ansiedad, envidia, credulidad y, por cierto, a nuestra lujuria.

Es decir, las tecnologías persuasivas apelan a mantenerte en la versión

más débil de ti mismo para que gastes tu tiempo en las redes.

Algunos críticos han dicho que el documental es alarmista, o que

carece de perspectiva histórica para entender que estos fenómenos no

son tan nuevos.

Como todo documental, deja sin cubrir aspectos importantes, como el

cruce entre la tecnología y las desigualdades. Pero no percibo un

alarmismo exagerado.

Quienes critican estos discursos tienen una frase típica: "Estas cosas

siempre existieron". Y es verdad. De hecho, Facebook hizo un estudio

para mostrar que la red social influye menos en la polarización

política que nuestro apego innato a los amigos de ideas afines.

Pero el mismo estudio mostró que los algoritmos de recomendación de

Facebook duplican ese efecto, y ahí está el problema. Los huevos y la

carne siempre subieron el colesterol, pero en las últimas décadas

potenciamos ese efecto con una avalancha de helados y papas fritas.

¿Me explico?

Lo que pasa es que nos cuesta admitir el efecto en nosotros mismos.

Nos preocupa mucho ver a nuestros hijos pegados todo el día a un

chupete digital, incapaces de concentrarse o asimilando expectativas

poco realistas sobre sus cuerpos. Pero nosotros somos otra cosa,

usamos las redes por divertirnos, nadie nos mete un chupete en la

boca.

Pero es un hecho que la tecnología digital también nos presta

servicios imprescindibles. La pandemia lo ha dejado bastante

claro.

Sin duda, y eso no tiene vuelta atrás.

El crecimiento de la digitalización siempre fue exponencial. Hace 25

años no teníamos celulares y ya es imposible imaginarlo. Pero la

pandemia lo aceleró con esteroides. Aunque también mostró sus

limitaciones, ¿no?

Yo doy clases en línea hace años y conozco muy bien sus desventajas,

pero ahora cada maestra de primaria descubrió que con niños de 7

años no funciona para nada.

También aceleró el debate sobre la privacidad, que antes era más

teórico: ¿qué escucha Siri, qué escucha Alexa? Ya no hace falta

ninguna Siri, todas las casas están conectadas y toda la familia

está en la casa.

El otro día un papá inocente se puso los pantalones mientras mi hija

de 6 años estaba en clases, y claro, había unas 30 familias viendo a

un viejo medio desnudo atrás. O de pronto escuchas a una pareja

peleándose en el otro cuarto. Aunque no quieras, ya te metes en la

casa de otros todo el tiempo.

Las herramientas digitales de vigilancia han sido otro problema

difícil de tratar. Solíamos resistirnos a ellas, pero este año nos

interesó mucho la aplicación de rastreo de Corea del Sur, por

ejemplo, que era la más invasiva de todas.

Claro, la gente está casi enojada porque las apps de rastreo todavía

no funcionan. Y el problema no es tecnológico, es político. Aquí se

evidencian dos problemas serios.

Primero, la gente todavía no entiende bien lo que las grandes

compañías hacen con sus datos. En marzo, cuando Apple y Google

anunciaron su aplicación, todos dijeron "ay, no, ahora Apple y

Google nos quieren coleccionar esos datos". ¡Apple y Google

coleccionan esos datos siempre!

Y segundo, los gobiernos fueron incapaces de reaccionar a un desafío

tecnológico de lo más sencillo.

Los privados les dijeron "nosotros ponemos los datos, ustedes

desarrollen la app". Y los gobiernos en medio año no lograron

coordinarse ni empujar un diálogo político, porque no tienen el

lenguaje para esto, no pueden vender un mensaje.

En Estados Unidos ni siquiera lograron ponerse de acuerdo al

interior de cada estado. Y hace poco más de un mes, Apple y Google

dijeron "ya, son tan incapaces los gobiernos que vamos a tomar este

asunto en nuestras manos".

Como la ley les impide instalar la app sin la venia estatal, van a

integrar la función en el sistema operativo del teléfono y cada

usuario verá si la habilita. Esto demuestra que la ventaja del

sector privado en este tema es hoy insuperable.

Por lo menos en Occidente.

Exacto, esto sí funcionó en países asiáticos que habían aprendido

del SARS −aunque la app de Corea del Sur, como decías, publica más

datos de los necesarios− y en países autoritarios donde

simplemente no hay discusión.

En China revisan hasta los datos de tu tarjeta de crédito para

supervisar tu cuarentena. Para el gobierno, la emergencia lo

justifica y punto. Pero los gobiernos occidentales no saben qué

justificar porque ni siquiera saben plantear la discusión. Es

preocupante.

Para ser justos, la disputa entre la privacidad y la seguridad

nunca ha sido fácil de plantear en países democráticos.

Yo crecí en una Alemania dividida donde un Estado de vigilancia

controlaba medio país, así que me preocupo mucho por mi

privacidad. Pero más me preocupo por mi madre de 70 años que aún

vive en Alemania, ¿no?

El verdadero problema, como advirtió Yuval Harari, es evitar que

las medidas de emergencia se queden cuando vuelva la normalidad.

La pandemia también nos permitió constatar que las noticias

falsas se multiplican aun cuando no haya intereses políticos

detrás.

Sí, aquí el problema es la economía de la atención misma.

Al algoritmo no le importa hacia qué lado te llevan las noticias

falsas, simplemente le sirven para atraparte porque cuadran mejor

que la verdad con nuestros sesgos cognitivos. En particular, con

dos de ellos.

¿Cuáles?

Uno es el sesgo de confirmación: si una información refuerza tu

opinión, se ha verificado que es un 90% menos probable que la

identifiques como falsa. Y aun si te dicen que era falsa, es un

70% más probable que un tiempo después la recuerdes como

verdadera.

El otro es el sesgo de novedad.

Nosotros evolucionamos para prestar una atención desproporcionada

a lo novedoso. Al que no lo hizo, se lo comió el tigre. Y la

verdad no suele ser novedosa, ya la has escuchado antes.

Así las noticias falsas obtienen en las redes 20 veces más retuits

que las verdaderas.

Y la ventaja de los algoritmos es que estas conductas son

predecibles: somos irracionales, pero predeciblemente

irracionales.

Entonces, si fueras un algoritmo programado para atraer clics,

¿qué harías para sobresalir en tu trabajo durante una pandemia?

Priorizar mensajes alarmantes que culpen a minorías religiosas de

propagar el virus, o al ejército gringo de llevarlo a Wuhan.

Te irá muy bien en las famosas "métricas neutrales", que

supuestamente privilegian "lo que nos gusta" pero en realidad

maximizan las ganancias a expensas de la polarización.

Y de nuestro bienestar emocional, según creen muchos

psicólogos.

El año pasado, un estudio experimental concluyó que desactivar

Facebook por un mes aumenta tu bienestar subjetivo tanto como

ganar 30 mil dólares adicionales al año.

La explosión de las redes ha coincidido con aumentos medibles de

la ansiedad, de la percepción de soledad, del suicidio

adolescente, sobre todo de las chicas…

Comprendamos que estos algoritmos no afectan a todos por igual:

buscan a los más débiles entre nosotros y les pegan bajo el

cinturón.

Si una chica de 14 años busca un video en YouTube sobre cómo

comer mejor, el algoritmo pronto le recomendará un video sobre

anorexia, porque la experiencia le dice que captará su atención.

Y si ella es débil, tomará ese camino.

Los usuarios de YouTube, que son dos mil millones, ven en

promedio 40 minutos de videos al día, de los cuales los

algoritmos recomiendan el 70%. Alrededor del 5% de las

recomendaciones son teorías conspirativas absurdas: que la

Tierra es plana, que las vacunas son peligrosas, etc.

Haciendo números, dos de cada siete personas en el mundo ven en

promedio 1,5 minutos diarios de teorías conspirativas. ¡Es casi

una religión global! No creo que tantos cristianos recen a

diario.

Si ves ese tipo de videos, empiezas a dudar de todo. Y si la

verdad de los hechos ya no cuenta, las reglas tampoco. Por eso

crear confusión les interesa tanto a los líderes populistas o

autoritarios.

También circulan teorías absurdas sobre la manipulación

digital, o sobre las intenciones ocultas que tendría Mark

Zuckerberg.

Claro, algunos creen que Zuckerberg estudia nuestra personalidad

para irse a un sótano oscuro con el Joker y Darth Vader a

planear cómo dominar el mundo.

Pero no funciona así. Ni siquiera hay muchos psicólogos en

Silicon Valley.

Las tecnologías persuasivas encuentran nuestras debilidades por

ensayo y error, con pruebas ciegas de A/B: ponen dos versiones

de un mensaje y ven cuál produce más clics.

Así descubrieron que las publicaciones que expresan indignación

obtienen el doble de likes y casi el triple de shares.

Este método ciego, de hecho, redescubrió estrategias que

figuraban hace años en los manuales de diseño de casinos,

pensados para hacerte adicto.

Otra emoción muy exitosa es el miedo, porque reaccionar al

miedo de la tribu es también un aprendizaje evolutivo.

Cuando un búfalo siente el miedo de otro miembro de la manada,

echa a correr sin saber por qué.

Y tú no revisaste en febrero tu pila de papel higiénico porque

tuvieras noticias sobre la cadena de suministro, sino por el

temor colectivo. Pues bien, #toiletpapergate y

#toiletpapercrisis fueron las principales tendencias en

Twitter a finales de febrero.

Para decir algo en su favor, algunas redes sociales

filtraron muchas noticias falsas sobre la pandemia, en un

esfuerzo inédito de su parte.

Sí. Amazon eliminó muchos productos que mentían sobre el virus

y Facebook mostró advertencias en millones de publicaciones

que hacían lo mismo.

Cuando las personas vieron esas etiquetas de advertencia, el

95% de las veces no hicieron clic en la noticia. ¿Pero cuánto

sirve eso, si la gran mayoría sólo lee titulares? La gente no

se molesta en leer el contenido del 70% de los links que

retuitea.

Y ese 5% que no fue disuadido por la advertencia ya son dos

millones de personas.

Avaaz, una organización sin fines de lucro, informó que 104

afirmaciones falsas sobre el virus se vieron más de 117

millones de veces en Facebook durante marzo, y que la compañía

tardó hasta 22 días en emitir las advertencias.

Y hablamos del contenido en inglés, en otros idiomas filtran

muchísimo menos.

Esto debe preocupar a los latinoamericanos, porque son líderes

mundiales en el uso de redes sociales: 3,5 horas diarias en

promedio.

¿Eres partidario de que los Estados regulen con más

fuerza el uso de estas tecnologías?

¡Por supuesto! Es verdad que las regulaciones eficientes

suelen llegar cuando una industria ha alcanzado cierta

escala, porque es difícil anticipar los riesgos.

Cuando apareció el automóvil, uno de los argumentos en su

favor fue que haría las ciudades más saludables al reducir

los excrementos de caballos.

Pero no podemos dejar las reglas de la sociedad en manos de

unos pocos ingenieros. ¿Dónde se deben almacenar los datos?

¿Qué tipo de datos? ¿Con qué finalidad pueden usarse?

Tenemos que sacar estas preguntas nerds del garaje de los

programadores, porque estamos quebrando varios acuerdos

sociales con el poder de esta economía desregulada.

En un artículo reciente propones que, así como hemos

modificado conductas para cuidarnos del virus, deberíamos

adoptar medidas de "desinfección digital".

Claro. La gente sabe que ya es suficiente con ocho horas de

trabajo frente a la pantalla. Pero entra en su dormitorio,

se toma dos respiros y saca su celular igual, ya no puede

evitarlo.

Y por mucho que Apple y Google agreguen funciones para

ayudarte a monitorear tu consumo digital, sus tecnologías

siguen diseñadas para la adicción.

Tú dices "no, sólo voy a chequear una notificación". Y 40

minutos después, dices "¡oh, qué me pasó!". Pasó que tu

cerebro paleolítico no es rival para el aprendizaje

automático de las supercomputadoras acerca de tu voluntad.

De ahí las preguntas más existenciales sobre qué es la

voluntad humana en este contexto.

Ya lo decía Schopenhauer: "El humano puede hacer lo que

quiere, pero no puede querer lo que quiere". Eso tampoco es

nuevo.

Lo nuevo es que las mentes artificiales, al descubrir los

sesgos de esa voluntad, han empezado a competir con ella por

nuestra percepción consciente de la realidad.

Esto puede sonar loco, pero creo que estamos generando una

nueva presión evolutiva sobre el Homo sapiens.

Porque si queremos coexistir con máquinas que procesan

información mucho mejor que nosotros, la humanidad tendrá

que producir un salto de conciencia. Es decir, evolucionar

hacia formas de conciencia menos apegadas a procesos de

información.

¿Y crees que podemos inducir una evolución de ese

tipo?

No le pidas tanta iluminación a un académico, pero te

cuento algo que me sorprendió mucho.

Hace poco analicé, con datos de Facebook, qué ha hecho la

gente en su tiempo libre durante la pandemia en América

Latina. Y la única actividad que se disparó respecto de

épocas normales fue la meditación, tanto en interés de la

gente como en descargas de apps.

Las mujeres, que siempre lideraron el uso de estas apps,

duplicaron su uso. Y los hombres triplicaron el suyo,

llegando al nivel que tenían las mujeres en 2019.

¿Y qué busca la meditación? Desconectarte hasta de tus

pensamientos.

Y las tecnologías persuasivas funcionan como extensiones

de nuestras mentes, de ese diálogo interior que no podemos

parar.

Como cuando estás enojado y argumentas en tu cabeza con la

otra persona y le dices todo lo malo que te ha hecho y

todo lo que no sabe.

Estas tecnologías se conectan a ese diálogo interior, lo

externalizan a través de las redes sociales y ahí te

agarran.

Entonces, es interesante que sea la meditación, un posible

antídoto para eso, lo que ha explotado. El 15% de los

usuarios de Facebook en América Latina ya muestra interés

en ella.

¿Sería contradictorio que busquen el antídoto en las

mismas redes?

Es que no se trata de apagar internet. Tampoco es una

opción si quieres ser parte de la evolución de esta

sociedad.

En Silicon Valley, de hecho, también hay bastante interés

en la meditación. Están experimentando con frecuencias

sonoras, para encontrar aquellas cuyos efectos cerebrales

ayudan a inducir el desapego y descansar de esta constante

conexión.

¿Y sabes lo que descubren? Que ciertas frecuencias

producen en tu cerebro el mismo efecto que una fogata.

Otra vez, aquí no hay nada nuevo, las tradiciones

espirituales buscaban ese efecto hace miles de años para

despejar tu cabeza.

Porque si miras dentro de ti, en tu cabeza no hay una sola

opinión, hay un comité discutiendo. Y cuando la gente

vuelve a intuir que necesita deshacerse de esas voces, es

porque descubre que son las mismas que corren en Facebook.

Ahora, desapegarte de esas voces no es tan sencillo como

descargar una app, son palabras mayores.

Pero antes, para intentarlo, tenías que renunciar a tu

trabajo, a tu familia y partir a las montañas a buscar un

maestro. La idea es que ahora puedas hacer tu fogata a las

7 de la tarde en tu departamento.

Crees que la salida, entonces, no será arrancar de la

tecnología sino combatirla con más tecnología.

Y es así porque la tecnología es normativamente neutral:

puede escalar los problemas o las soluciones, según el

uso que le demos.

Ahora, yo hablo de este interés en la meditación como

una señal positiva, pero no va a ser la pócima mágica.

Así como un bebé descubre los contornos de su cuerpo

mordiéndose el dedo, nosotros estamos recién conociendo

los contornos de nuestras mentes expandidas

digitalmente.

Pero estoy convencido de que aprender a tomar distancia

de estas tecnologías va a significar, en el largo plazo,

aprender a tomar distancia de uno mismo.

Un ególatra sin internet, en ese sentido, no sería parte

de la solución.

¿La idea de un chip en el cerebro es compatible con

lo que estás planteando? ¿O son excluyentes?

Si ese chip te mantiene en el nivel neuronal que procesa

información y la traduce en razonamientos y emociones,

no serviría para eso.

La conciencia está en otro nivel neuronal, parece que se

produce en un circuito que se llama DMN y que

básicamente conecta todo el cerebro.

Y me imagino que con una interfaz neuronal también se la

puede estimular, pero será como siempre en la

tecnología: la primera aplicación va a ser para comercio

y la segunda para pornografía.

Mientras tanto, ¿qué medidas de higiene podrías

recomendar?

Lávese la mente a menudo durante al menos 20 segundos,

especialmente después de un desplazamiento sin sentido

en las redes sociales durante el cual estuvo expuesto a

algoritmos especializados en bajar sus defensas.

Tápese la boca cuando esté a punto de difundir un

contenido odioso o que ni siquiera ha leído. Y asuma la

responsabilidad de ser un potencial vector de contagio

en este problema colectivo. / Por Daniel Hopenhayn.

Especial para BBC Mundo.--

___________________

NOTA: Las cookies de este sitio se usan para personalizar el contenido y los

anuncios, para ofrecer funciones de medios sociales y para analizar el

tráfico. Además, compartimos información sobre el uso que haga del sitio web

con nuestros partners de medios sociales, de publicidad y de análisis web.

Ver detalles.

IMPORTANTE: Todas las publicaciones son sin fines comerciales ni

económicos. Todos los textos de mi autoría tienen ©todos los derechos

reservados. Los contenidos en los link (vínculos) de las notas replicadas

(reproducidas) y/o citadas son de exclusiva responsabilidad de sus autores.

Éste blog ni su autor tienen responsabilidad alguna por contenidos ajenos.

No hay comentarios.:

Publicar un comentario

Bienvenido al blog y muchas gracias por su visita. Espero que el contenido sea de utilidad, interés y agrado.

Los comentarios están moderados. Antes de colocar un comentario lea bien las condiciones, tenga en cuenta que no se permitirán comentarios que:

- sean anónimos y/o posean sólo un nickname.

- no estén vinculados a una cuenta.

- posean links promocionando páginas y/o sitios.

- no se admite propaganda de ningún tipo

- puedan resultar ofensivos o injuriosos

- incluyan insultos, alusiones sexuales innecesarias y

palabras soeces o vulgares

- apoyen la pedofilia, el terrorismo o la xenofobia.

Este Blog ni su autor tiene responsabilidad alguna sobre comentarios de terceros, los mismos son de exclusiva responsabilidad del que los emite. De todas maneras, por responsabilidad editorial me reservo el derecho de eliminar aquellos comentarios que considere inadecuados, abusivos, injuriantes, discriminadores y/o contrarios a las leyes de la República Argentina.